Imagina este escenario: es 24 de abril de 2026. Tienes una tienda online en Cantabria. Quizás vendas calzado desde tu almacén en Torrelavega, material de surf desde Somo o distribuyas productos gourmet y anchoas desde Santoña. Tienes un catálogo sólido de unos 2.000 productos. Sin embargo, cuando entras a tus informes de cobertura, descubres que Google ha rastreado más de 45.000 URLs de tu dominio. ¿Cómo es esto posible? Y lo que es peor: tus productos estrella, los que realmente dejan margen de beneficio, no aparecen en los resultados de búsqueda o tardan semanas en actualizarse cuando cambias el precio.

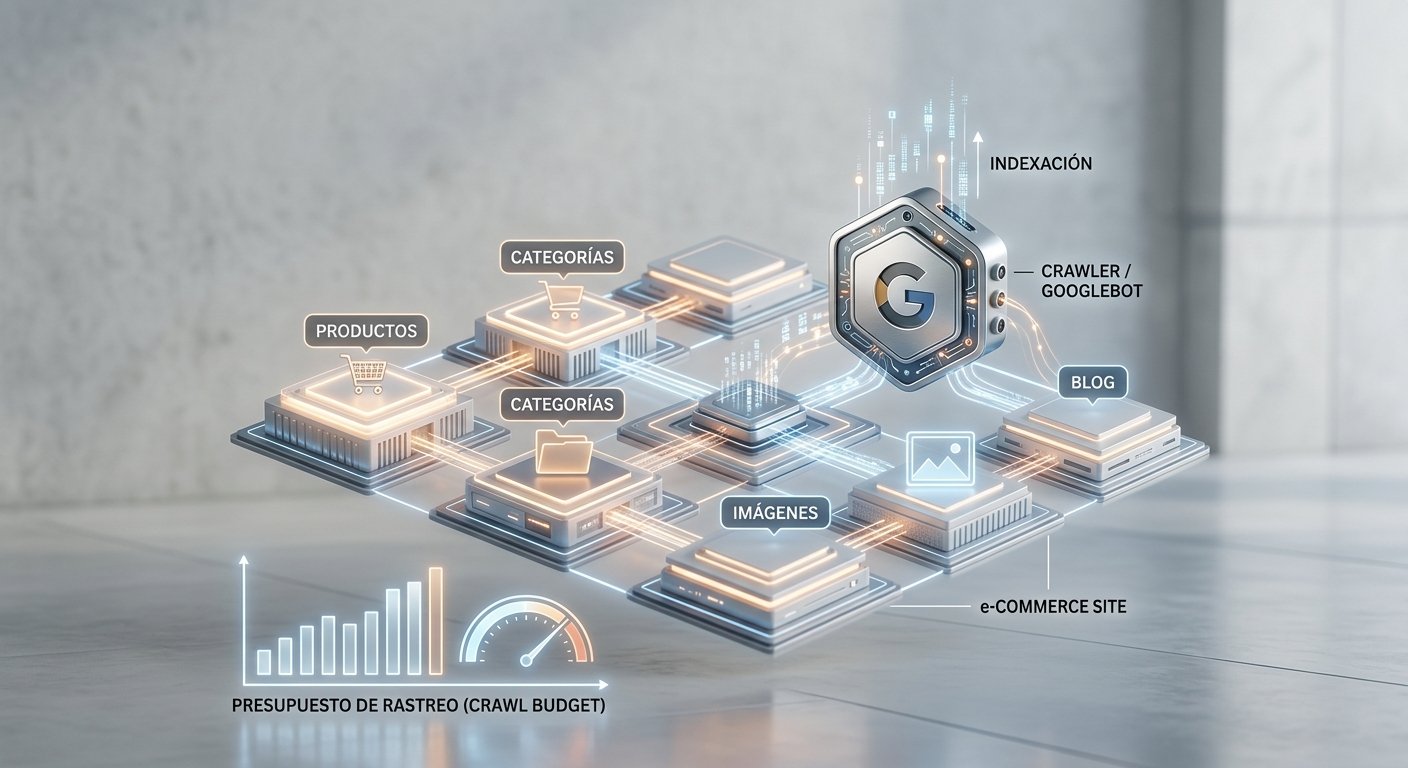

Este es el síntoma clásico de un problema invisible pero letal: el despilfarro de los recursos de rastreo de Google. En el mundo del comercio electrónico, tener la mejor oferta no sirve de nada si el motor de búsqueda se pierde en un laberinto técnico antes de llegar a ella. Entender cómo optimizar el crawl budget (o presupuesto de rastreo) es la línea que separa a un eCommerce que domina su nicho de uno que sobrevive con las migajas del tráfico orgánico.

Hoy vamos a desgranar este concepto. No nos quedaremos en la teoría superficial; vamos a profundizar en las entrañas de tu servidor y tu arquitectura para que comprendas, paso a paso, cómo guiar a los bots de los buscadores exactamente hacia donde tú quieres, evitando que pierdan tiempo valioso en páginas basura que no aportan valor ni ventas.

¿Qué es exactamente el Presupuesto de Rastreo SEO?

El presupuesto de rastreo seo (Crawl Budget) es, en términos sencillos, la cantidad de tiempo y recursos que Googlebot está dispuesto a invertir en tu sitio web durante un periodo de tiempo determinado. Google no tiene recursos infinitos. Rastrear miles de millones de páginas cada día requiere una capacidad de computación y un gasto energético monumental. Por lo tanto, el buscador asigna una «cuota» a cada dominio basándose en dos factores fundamentales:

- El límite de capacidad de rastreo (Crawl Rate Limit): Es el número máximo de conexiones simultáneas que el bot puede hacer a tu servidor sin tirarlo abajo. Si tu servidor en Santander es lento o devuelve errores 5xx cuando recibe muchas peticiones, Google reducirá la velocidad de rastreo para no perjudicar la experiencia de tus usuarios humanos.

- La demanda de rastreo (Crawl Demand): Es el interés que tiene Google en tu contenido. Si tu eCommerce es una autoridad, publica productos nuevos frecuentemente, recibe enlaces externos de calidad y tiene un buen volumen de tráfico, Google querrá visitarte más a menudo para mantener su índice fresco.

«El Crawl Budget no es un factor de posicionamiento directo, pero es el requisito previo absoluto para el SEO. Si Google no rastrea tu URL, no la indexa. Si no la indexa, no posiciona. Y si no posiciona, no vendes.»

Para una web corporativa de servicios de 30 páginas en Laredo, el presupuesto de rastreo no es una preocupación. Google la leerá de arriba a abajo en milisegundos. Pero para un eCommerce con categorías, subcategorías, etiquetas, paginaciones y filtros, la historia cambia radicalmente. Aquí es donde el seo técnico para ecommerce se convierte en una prioridad absoluta y no en un lujo.

Pro Tip: Antes de implementar cualquier cambio drástico, debes conocer tu punto de partida. Te recomiendo utilizar Google Search Console para realizar una auditoría. Revisa el informe de «Estadísticas de rastreo» (Crawl Stats) en los ajustes de la propiedad. Allí verás exactamente cuántas peticiones hace Google al día, qué tipo de archivos está descargando y cuál es el tiempo medio de respuesta de tu servidor.

El gran enemigo: La navegación por facetas y las URLs basura

Si hay un culpable principal de arruinar el Crawl Budget en un comercio electrónico, es la navegación por facetas seo. Imagina una tienda de moda online en Torrelavega. Tienes una categoría de «Zapatillas de deporte» con 50 modelos. Para ayudar al usuario, implementas un sistema de filtros en el lateral: talla, color, marca, precio, estilo.

Desde el punto de vista de la usabilidad (UX), esto es excelente. Pero desde el punto de vista técnico, cada vez que un usuario hace clic en un filtro, el sistema de tu eCommerce (sea WooCommerce, PrestaShop o Magento) genera una nueva URL dinámica añadiendo parámetros. Por ejemplo:

tusitio.es/zapatillas(La categoría principal)tusitio.es/zapatillas?color=azul(Filtro 1)tusitio.es/zapatillas?color=azul&talla=42(Filtro 1 + Filtro 2)tusitio.es/zapatillas?color=azul&talla=42&ordenar=precio-menor(Filtro 1 + Filtro 2 + Orden)

Matemáticamente, si tienes 10 colores, 8 tallas, 5 marcas y 4 opciones de ordenación, las combinaciones posibles generan miles de URLs únicas para una sola categoría. Estas URLs muestran prácticamente el mismo contenido (los mismos productos, solo que en diferente orden o reducidos). Si Googlebot encuentra los enlaces a estos filtros, intentará rastrearlos todos. Estará desperdiciando el 95% de su tiempo leyendo contenido duplicado o de escaso valor, en lugar de rastrear los nuevos productos que acabas de subir al catálogo.

Es vital que al elegir la plataforma de eCommerce ideal para tu pyme te asegures de que permite un control técnico avanzado sobre cómo se generan y bloquean estas rutas paramétricas.

Paso 1: Bloqueo estratégico mediante el archivo robots.txt

La primera línea de defensa para optimizar indexación google y proteger tu presupuesto de rastreo es el archivo robots.txt. Este archivo de texto alojado en la raíz de tu servidor es la primera parada de cualquier bot. Le dice explícitamente a Google por dónde puede y por dónde no puede pasar.

Si detectas que Google se está perdiendo en parámetros de ordenación (precio más alto, más reciente, etc.) o en filtros de búsqueda interna, debes bloquear esas rutas. Veamos un ejemplo técnico de cómo se vería un bloqueo efectivo:

User-agent: *

# Bloquear búsquedas internas

Disallow: /*?s=*

Disallow: /search/

# Bloquear parámetros de ordenación comunes

Disallow: /*?*orderby=*

Disallow: /*?*sort=*

# Bloquear filtros combinados complejos (ejemplo WooCommerce)

Disallow: /*?*filter_color=*

Disallow: /*?*filter_talla=*

# Evitar rastreo de carritos y áreas de cliente

Disallow: /carrito/

Disallow: /checkout/

Disallow: /mi-cuenta/

Al implementar estas directivas de Disallow, le estás diciendo a Googlebot: «No gastes tu valioso tiempo pasando por esta puerta, no hay nada útil para ti aquí, céntrate en el catálogo principal». Esto redirige inmediatamente la energía del bot hacia tus categorías reales y fichas de producto.

Sin embargo, hay que ser extremadamente cuidadoso con el robots.txt. Un error de sintaxis como un asterisco mal puesto puede bloquear toda tu web en minutos. Además, es importante recordar que bloquear una URL por robots.txt impide que se rastree, pero si la URL recibe enlaces internos o externos muy potentes, podría llegar a indexarse sin contenido (mostrando un mensaje de «Esta página no está disponible»). Por eso, esta técnica debe combinarse con otras.

Paso 2: Etiquetas Canonical vs Noindex (El dilema de la indexación)

Muchos dueños de negocios confunden el rastreo con la indexación. El rastreo es el acto de «leer» la página; la indexación es el acto de «guardarla» en la base de datos para mostrarla en resultados. Para que una página se indexe, primero debe ser rastreada. Pero no todo lo que se rastrea debe indexarse.

Cuando tratamos con URLs paramétricas o páginas que tienen contenido muy similar (por ejemplo, un mismo queso de Liébana vendido en formato cuña de 250g, 500g y 1kg, donde solo cambia el precio y el SKU), nos enfrentamos a la canibalización y al contenido duplicado. Para auditar contenido duplicado y evitar la canibalización, disponemos de dos herramientas fundamentales: la etiqueta Canonical y la etiqueta Noindex.

La etiqueta Canonical rel=»canonical»

La etiqueta canonical le dice a Google: «Esta URL es solo una variante. La versión principal y oficial a la que debes otorgar toda la autoridad SEO es esta otra». Se coloca en la sección <head> del código HTML.

<!-- Ejemplo en la página de zapatillas ordenadas por precio -->

<link rel="canonical" href="https://tusitio.es/zapatillas/" />

Nota crucial sobre el Crawl Budget: Las etiquetas canonical NO ahorran presupuesto de rastreo de forma inmediata. Googlebot tiene que rastrear la URL variante para poder leer la etiqueta canonical que está en el código, procesarla y entonces consolidar las señales. Si tienes un millón de URLs filtradas, Google gastará tiempo en leer el millón de canonicals. Las canonicals son para resolver problemas de duplicidad e indexación, no de rastreo en primera instancia.

La etiqueta Meta Robots «noindex»

Por otro lado, la directiva noindex le dice al buscador que, aunque lea la página, no debe mostrarla en los resultados de búsqueda. Al igual que el canonical, requiere que Google rastree la página para ver la directiva.

<meta name="robots" content="noindex, follow" />

A largo plazo, si Google rastrea una página repetidamente y ve que es noindex, reducirá la frecuencia con la que vuelve a visitarla, lo que indirectamente acaba liberando presupuesto de rastreo para otras zonas de la web. Sin embargo, para resultados inmediatos en eCommerce masivos de Cantabria, la combinación ideal es:

- Dejar que la navegación por facetas básica sea indexable y canonicalizada a sí misma si tiene búsquedas reales (ej. «Zapatillas de deporte rojas»).

- Aplicar

noindex, followa filtros de segundo nivel que no tienen volumen de búsqueda (ej. «Zapatillas de deporte rojas talla 42»). - Bloquear por

robots.txtaquellas URLs paramétricas infinitas generadas por ordenación de precios o fechas.

Pro Tip: Evita a toda costa el «cruce de directivas». No bloquees por robots.txt una URL que tiene una etiqueta noindex. Si la bloqueas, el bot de Google nunca podrá entrar a la página para leer el noindex, y si recibe un enlace, podría acabar indexada como una URL huérfana en los resultados de búsqueda.

Paso 3: Arquitectura Web y Enlazado Interno (El flujo de la autoridad)

El bot de Google navega por tu web siguiendo enlaces, como si fuera agua fluyendo por un sistema de tuberías. Si las tuberías están rotas, el agua se estanca. Si tu arquitectura es un desastre, el Crawl Budget se agota antes de llegar a los productos importantes.

Una pyme industrial en la cuenca del Besaya, por ejemplo, que vende maquinaria B2B compleja, no puede permitirse que sus fichas técnicas de producto estén a 6 clics de distancia de la página de inicio. Esto se conoce como una arquitectura «profunda». Cuanto más profundo esté un producto, menos probabilidades hay de que Google lo rastree con frecuencia.

La solución es diseñar una arquitectura web SEO plana. Ningún producto vital debería estar a más de 3 clics desde la home. Esto se logra mediante:

- Silos de Categorías Estrictos: La Home enlaza a Categorías. Las Categorías enlazan a Subcategorías. Las Subcategorías enlazan a los Productos.

- Megamenús Estratégicos: Utiliza el menú principal no para poner enlaces al «Aviso Legal», sino para enlazar a tus categorías más importantes y rentables.

- Productos Relacionados (Cross-selling): En cada ficha de producto, muestra bloques de «Productos que también te podrían interesar». Esto crea una red transversal de enlaces internos masiva que ayuda al bot a saltar de un producto a otro sin tener que volver a la categoría superior.

- Paginaciones Limpias: Asegúrate de que los enlaces de tus paginaciones (1, 2, 3, Siguiente) son enlaces HTML reales (

<a href="...">) y no cargas por JavaScript sin URL definida (como el scroll infinito mal implementado), ya que los bots prefieren enlaces tradicionales para descubrir contenido.

Si además quieres atraer clientes a tu tienda en Cantabria (integrando la venta física con la digital), asegúrate de que desde la Home o el footer siempre haya enlaces claros hacia tus landings locales (ej: «Nuestra tienda en Santander»). Esto garantiza que el bot rastree rápidamente tus páginas orientadas a negocio local.

Paso 4: Limpieza de Sitemaps y Cadenas de Redirecciones

El archivo sitemap.xml es como el mapa del tesoro que le entregas a Google en bandeja de plata. Es tu forma de decirle: «De todas las URLs que hay en mi servidor, estas son exactamente las que considero de alta calidad y quiero que indexas».

El mayor error que cometen las tiendas online es enviar un sitemap sucio. Un sitemap sucio contiene:

- URLs que redirigen a otra parte (Códigos 301 o 302).

- URLs que devuelven errores (Códigos 404 o 500).

- URLs que tienen la etiqueta

noindexo canonicalizan a otra página.

Si Google lee tu sitemap y constantemente encuentra basura, errores o páginas no indexables, perderá la confianza en ese archivo. Dejará de visitarlo con frecuencia y tu presupuesto de rastreo seo se resentirá. Tu objetivo debe ser que el 100% de las URLs dentro de tu archivo XML Sitemap devuelvan un código de estado HTTP 200 OK, sean indexables y sean las versiones canónicas definitivas.

«Un sitemap XML no fuerza a Google a rastrear, pero un sitemap impecable entrena a Google para que confíe en tus indicaciones, optimizando drásticamente la tasa de rastreo de tus nuevas URLs.»

De igual forma, audita tus redirecciones internas. Si borraste un producto antiguo en 2024 e hiciste un redirección 301 a la categoría, asegúrate de que en toda tu web has actualizado los enlaces internos para que apunten directamente a la categoría, en lugar de pasar por el enlace viejo que redirige. Los «saltos» de redirección (A -> B -> C) consumen Crawl Budget rápidamente y diluyen el PageRank.

Paso 5: Rendimiento del Servidor (WPO) y Análisis de Logs

Llegamos al terreno más técnico pero más impactante para grandes volúmenes de datos. Recuerda la primera regla del Crawl Budget: Google ajusta su velocidad según la capacidad de tu servidor. Si tu servidor tarda 2 segundos en devolver el primer byte de información (TTFB – Time To First Byte), Googlebot interpretará que el servidor está bajo estrés y reducirá la frecuencia de rastreo para no saturarlo.

Si en lugar de 2 segundos, optimizas tu web para que responda en 200 milisegundos, en el mismo tiempo que antes Google rastreaba 1 URL, ahora podrá rastrear 10. Es pura matemática. Mejorar la velocidad de tu web (WPO) no solo es crucial para la experiencia de tus clientes de Cantabria que compran desde el móvil con conexión 4G, sino que es la forma más directa de «comprar» más presupuesto de rastreo.

Para lograrlo en un eCommerce, necesitas:

- Un servicio de alojamiento (Hosting) potente, preferiblemente VPS o Servidor Dedicado, con recursos de CPU y RAM no compartidos.

- Sistemas de caché a nivel de servidor (Redis, Memcached) para las consultas pesadas a la base de datos que exigen los catálogos grandes.

- Implementar una CDN (Content Delivery Network) que sirva las imágenes pesadas de los productos rápidamente.

Para las empresas del sector industrial que manejan catálogos masivos o multi-idioma y necesitan un rendimiento extremo, la tendencia actual es abandonar las arquitecturas monolíticas lentas y utilizar un stack headless con IA para potenciar tu SEO B2B. Al separar el frontend del backend (usando tecnologías como Next.js), las páginas se pueden pre-renderizar de forma estática en el servidor, entregando el HTML a los bots de Google casi a la velocidad de la luz, maximizando el Crawl Budget al extremo.

Pro Tip Nivel Experto: El Análisis de Logs. Search Console te da una muestra de los datos, pero los registros puros de tu servidor (Log Files) te dan la verdad absoluta. Analizando los logs de tu servidor Apache o Nginx (filtrando por el agente de usuario «Googlebot»), puedes ver exactamente qué URL solicitó el bot, en qué segundo preciso y qué código de respuesta recibió. Así descubrirás si Google pasa todas las madrugadas rastreando una subcarpeta inútil que ni sabías que existía.

Paso 6: Gestión de Productos Agotados y Descatalogados

En el comercio minorista, el stock rota. Si tienes una tienda de ropa en el centro de Santander, cada temporada cambias el catálogo. ¿Qué haces con las páginas de los productos que ya no tienes y no volverán?

Dejar miles de productos descatalogados acumulándose año tras año como páginas 404 (No encontrado) o Soft 404 agota inútilmente el rastreo. La estrategia correcta es:

- Ruptura de stock temporal: Si el producto va a volver, mantén la URL viva (200 OK), deja el producto visible, pero permite al usuario dejar su email en un botón de «Avisarme cuando haya stock». No cambies nada técnico, mantienes el SEO y captas leads.

- Producto descatalogado permanente con sustituto: Si un modelo de botas de 2025 ya no se fabrica pero tienes el modelo equivalente de 2026, haz una redirección 301 de la URL vieja a la URL del modelo nuevo.

- Producto descatalogado sin sustituto directo: Si el producto muere y no hay alternativa obvia, haz una redirección 301 hacia la subcategoría o categoría padre más relevante.

- Limpieza masiva: Si tienes miles de productos viejos sin tráfico orgánico y sin enlaces externos entrantes (backlinks), devolver un código 410 (Gone / Desaparecido) es la señal más clara para Google de que debe eliminar esa URL de su índice inmediatamente y no volver a gastar presupuesto de rastreo en ella.

# Ejemplo en .htaccess para marcar un producto permanentemente eliminado

Redirect 410 /zapatos/modelo-viejo-2023/

Conclusión: Domina las reglas del juego técnico

Para la mayoría de los negocios en Cantabria, el SEO suele entenderse como «poner palabras clave en los textos» o «escribir artículos en un blog». Y aunque el contenido es fundamental, en entornos transaccionales grandes como un eCommerce, la tecnología dicta las reglas del juego. Puedes tener los mejores textos del mundo detallando la historia de tus productos cántabros, pero si tienes la web plagada de navegación por facetas indexable, redirecciones rotas y un servidor lento, Google sencillamente no tendrá la capacidad de procesar y valorar ese contenido.

Optimizar el Crawl Budget es, en esencia, un ejercicio de eficiencia. Se trata de ponerle una alfombra roja a Googlebot, cerrando las puertas de los callejones sin salida y mostrándole un camino claro, rápido y seguro hacia las páginas donde realmente generas conversiones y dinero. Realiza una auditoría técnica profunda, domina tu archivo robots.txt, mantén un mapa del sitio impecable y asegura tiempos de carga ultrarrápidos. Cuando le facilitas la vida a los motores de búsqueda, los motores de búsqueda te recompensan facilitándote clientes.